Accélération de l'IA, la "Course au Pouvoir" et Risque de Choc Sociétal à Court Terme Jusqu'en 2035 (Partie 1 : Vision à Court Terme)

Résumé exécutif MAIN[1] [2] [3] [4] [5]

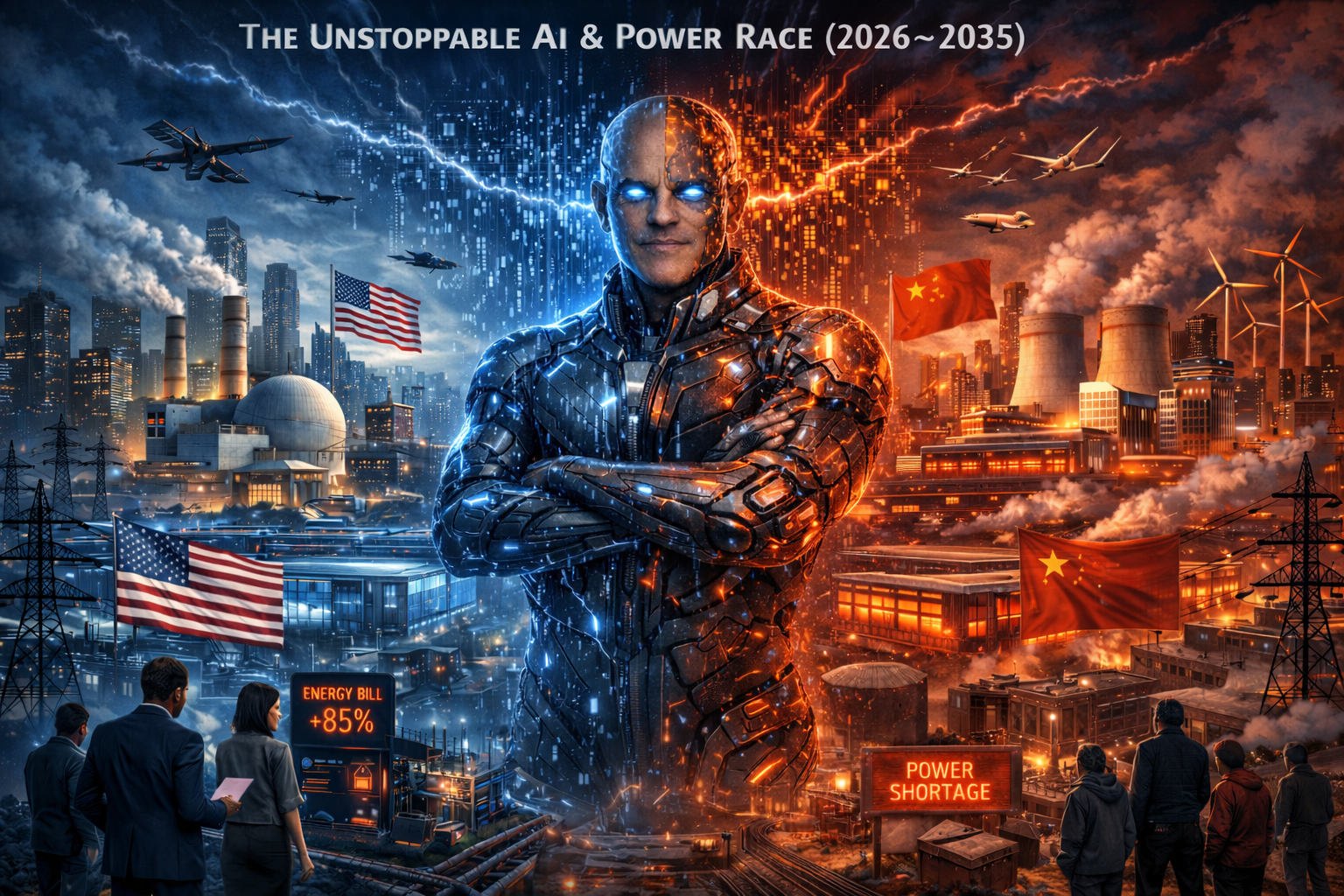

L’essai de Matt Shumer de février 2026, « Something Big Is Happening », soutient qu’un changement perceptible de « bascule d’urgence » s’est produit parce que les laboratoires de pointe livrent désormais des modèles agentiques capables d’effectuer du travail de longue durée avec des outils, et — point crucial — qu’ils sont utilisés au sein des boucles de R&D de leurs propres créateurs, ce qui accélère l’itération vers des capacités de type AGI (ou au-delà) à un rythme que la plupart des institutions ne peuvent pas absorber. Un contrôle de réalité à court terme (février 2026) confirme l’hypothèse d’« accélération » — surtout dans le code, les workflows agentiques et le travail intellectuel professionnel — tout en montrant encore des limites dures en fiabilité, en raisonnement exact à forte complexité, et en opération autonome sûre sans garde-fous. Le moteur le plus « inarrêtable » n’est pas seulement la pression commerciale, mais l’encadrement explicite de sécurité nationale de la compétition États-Unis–Chine : les principaux gouvernements décrivent le leadership en IA comme une domination stratégique, ce qui crée de fortes incitations à la défection (dynamiques de course) et affaiblit la plausibilité de pauses significatives. La contrainte à court terme — et accélérateur — sous-estimée est l’énergie et l’infrastructure physiques : capacité du réseau, files d’attente d’interconnexion, transformateurs/sous-stations, autorisations de lignes, refroidissement/eau, implantation foncière, et structures d’approvisionnement énergétique (p. ex. « apportez votre propre production ») qui déterminent de plus en plus qui peut déployer l’IA à l’échelle et où. Sur le plan juridique, une « IA devenant illégale » au sens global est peu probable d’ici 2035 ; à la place, le système devient illégal par des usages spécifiques, des contextes de déploiement, des échecs de sécurité/conformité et des contrôles transfrontaliers — avec des « lignes claires » à court terme déjà actives dans l’UE (pratiques interdites depuis février 2025 ; obligations échelonnées pour les modèles à usage général jusqu’en août 2026/2027), et des régimes croissants de contrôle des exportations et au niveau des États aux États-Unis, le tout compliqué par la course aux armements.

Source d’ancrage [1]

Matt Shumer a publié « Something Big Is Happening » autour du 9 février 2026 et l’a présenté comme une inflexion générationnelle — en comparant explicitement le moment au fait de réaliser que « quelque chose d’énorme » est en cours et que la plupart des gens continuent d’agir comme si le changement était encore à des années. Son affirmation centrale est que des sorties récentes de pointe (il met en avant des lancements de modèles du 5 février) ont rendu pour lui indéniable que l’IA progresse vers une ère où elle peut exécuter un travail significatif avec une supervision humaine minimale, y compris des tâches relevant du « jugement / goût » plutôt que de la simple complétion automatique. [1]

Le « coup de poing » le plus viral de Shumer est le changement vécu dans les workflows : « Je ne suis plus nécessaire pour le travail technique proprement dit. Je décris le résultat que je veux et il apparaît. » Il soutient que ce n’est pas une astuce de développeur de niche, mais un avant-goût d’un déplacement massif des cols blancs une fois que les organisations auront rééquipé leurs workflows autour de systèmes agentiques. [6]

Sur la viralité et la portée plus large, de grands médias ont rapporté que l’essai s’est diffusé rapidement sur les réseaux sociaux et a été relayé par la presse économique ; un article a décrit qu’il avait atteint des dizaines de millions de vues (p. ex. « plus de 80 millions de vues » sur X, selon la collecte/le moment de mesure), indiquant qu’il a servi de document public « réveil » plutôt que de billet purement technique. [1]

Shumer ancre la bascule d’urgence dans les sorties du 5 février : le modèle de codage agentique d’OpenAI (GPT-5.3-Codex) et le nouveau vaisseau amiral d’Anthropic (Claude Opus 4.6), qu’il présente comme une preuve que les « capacités sont arrivées » et que les conséquences économiques et géopolitiques sont désormais sur une horloge de court terme (2026-début des années 2030), pas une horloge de futur lointain. [7]

Il souligne aussi une boucle de rétroaction : les laboratoires de pointe utilisent de plus en plus des modèles de pointe pour accélérer la création, l’évaluation, le déploiement et le travail de sécurité autour des prochains modèles — une dynamique interne de « composition » qui (si elle continue) compresse les calendriers.

🚀 Mise à l’échelle du calcul d’entraînement de l’IA — données historiques & projections divergentes jusqu’en 2035 (échelle log)

Vérification de réalité technologique

À quoi ressemble concrètement la « capacité de février 2026 » en pratique [2] [7]

Le codage agentique et les workflows pilotés par des outils sont le saut le plus net. La fiche système de GPT-5.3-Codex d’OpenAI le décrit comme le modèle de codage agentique le plus capable qu’elle ait livré, conçu pour des tâches de longue durée impliquant recherche, usage d’outils et exécution complexe, et note qu’il peut être guidé « comme un collègue » sans perdre le contexte. OpenAI signale aussi un point interne pivot : c’est la première fiche système qui décrit un modèle de pointe comme « instrumental » dans sa propre création (via des versions antérieures utilisées dans les workflows de développement), ce qui constitue une version concrète et étroite de « l’amélioration récursive » (dirigée par l’humain, médiée par des outils, mais cumulative). [2]

La posture de sécurité en février 2026 reconnaît implicitement une croissance dangereuse des capacités. OpenAI indique que GPT-5.3-Codex est traité comme « haute capacité » en biologie et (par précaution) « haute capacité » en cybersécurité dans le cadre des garde-fous de son Preparedness Framework, tout en déclarant qu’il n’atteint pas le niveau de « haute capacité » en auto-amélioration de l’IA. Cette combinaison compte : elle suggère que le risque à court terme est moins « le modèle s’améliorant lui-même de façon autonome » que « le modèle augmentant matériellement la capacité humaine (et organisationnelle) dans des domaines à enjeux élevés », en particulier les opérations cyber. [2]

Quantitativement, le saut est visible dans au moins certaines évaluations cyber internes. Dans la fiche système d’OpenAI, GPT-5.3-Codex surpasse les modèles de comparaison listés précédemment sur un taux de réussite combiné « Cyber Range » (80 % vs des bases plus faibles). Même en considérant les évaluations internes avec prudence, la direction est cohérente avec des reportages indiquant que la défense et l’attaque cyber figurent parmi les applications « agentiques » qui évoluent le plus vite. [8] [9]

Du côté d’Anthropic, Claude Opus 4.6 est présenté comme un modèle de raisonnement hybride avec des « capacités avancées en travail intellectuel, code et agents », et Anthropic cite de bonnes performances sur des benchmarks de travail professionnel dans ses documents de lancement. Le cadrage post-lancement sur le « risque de sabotage » est particulièrement révélateur : il définit le « sabotage » comme une altération ou manipulation autonome des systèmes/décisions d’une organisation qui augmente le risque catastrophique et — tout en concluant que le risque global est « très faible mais non négligeable » — note explicitement qu’Opus 4.6 est massivement utilisé chez Anthropic pour le code, la génération de données et des cas d’usage agentiques.

« Jugement/goût » et prise de décision autonome : ce qui est réel vs ce qui relève du battage [10] [11]

Le cadrage « jugement/goût » de Shumer correspond à deux tendances mesurables : (1) un meilleur suivi des instructions et une baisse des taux d’hallucination dans les nouveaux modèles de pointe, et (2) un comportement à long horizon plus cohérent sous usage d’outils. OpenAI traite explicitement les hallucinations comme un défi fondamental persistant, même en rapportant des réductions dans la famille GPT-5. [12]

Mais des effondrements de fiabilité apparaissent encore sous certaines formes de complexité, notamment le raisonnement algorithmique/exact. Une lignée de recherche Apple largement citée (« The Illusion of Thinking », juin 2025) constate que les « modèles de raisonnement » peuvent montrer un avantage à complexité moyenne mais connaître un « effondrement complet » à plus haute complexité, avec un raisonnement incohérent et un échec à appliquer des algorithmes explicites de façon fiable. C’est un contrepoids clé aux récits « AGI dans un an » : de nombreuses tâches économiquement utiles exigent non seulement du texte plausible, mais une exécution fiable face aux cas limites, aux contraintes changeantes et aux conditions adverses.

Robotique et agency physique : le « pont » 2026-2030 qui détermine la vitesse de disruption dans le monde réel [13]

Dans la fenêtre de court terme que Shumer met en avant, les robots comptent parce qu’ils convertissent les capacités cognitives en agency physique, étendant l’automatisation du « travail sur écran » à la logistique, à la fabrication et, à terme, aux services.

Plusieurs signaux entre 2024 et février 2026 montrent que la pile incarnée progresse, quoique de manière inégale : [14]

Boston Dynamics a déclaré début 2026 qu’elle commence la fabrication d’une version produit de son humanoïde Atlas, avec des déploiements 2026 prévus chez Hyundai et Google DeepMind, et que l’Atlas sera entraîné via de nouvelles approches de modèles fondamentaux pour des tâches industrielles. [15]

BMW a rapporté en septembre 2024 que l’humanoïde Figure 02 de Figure était testé à l’usine BMW Group de Spartanburg dans un environnement de production réel, avec des spécifications physiques indiquées (taille, poids, capacité de charge), signalant une adoption pilote « usine » précoce. [16]

Reuters a rapporté en 2025 que Mercedes-Benz a investi dans Apptronik et a testé des humanoïdes « Apollo » dans ses usines, décrivant une trajectoire où la téléopération entraîne d’abord les tâches que le robot apprend ensuite à effectuer de façon plus autonome. [17]

Du côté recherche, des travaux 2024-2025 sur des politiques robotiques généralistes (p. ex. OpenVLA entraîné sur ~970k démonstrations robotiques réelles ; jeux de données Open X-Embodiment permettant le transfert inter-robots) indiquent une tentative réelle de « LLM-iser » la robotique via l’échelle vision-langage-action — tout en reconnaissant ouvertement les défis d’adoption et le besoin de fine-tuning et de généralisation efficaces. [14]

La prévision robotique la plus crédible à court terme n’est pas « des humanoïdes partout d’ici 2027 », mais : la disruption commence par le travail sur écran (2026-2030), et la disruption du travail physique s’accélère à mesure que les robots deviennent plus fiables, moins chers et plus simples à déployer dans des environnements contraints (usines, entrepôts) avant les environnements ouverts. Cela correspond au schéma des pilotes industriels (BMW/Figure ; Mercedes/Apptronik ; déploiements 2026 prévus par Boston Dynamics) plutôt qu’à une explosion soudaine de robots grand public.

Fourchettes de calendriers d’experts (2026-2035) vs l’urgence « quelques années » de Shumer

Des visions « AGI bientôt » à court horizon sont désormais exprimées par plusieurs leaders de pointe, mais avec des réserves importantes et une ambiguïté de définition : [18]

Dario Amodei a écrit en février 2025 que « possiblement d’ici 2026 ou 2027 » les capacités IA pourraient ressembler à un « pays de génies dans un datacenter », en soulignant l’urgence et des implications d’échelle nationale. [19] [13]

Sam Altman en juin 2025 a prévu une progression par étapes : 2025 comme l’arrivée d’agents faisant un vrai travail cognitif, 2026 comme des systèmes trouvant des « idées nouvelles », et 2027 comme des robots effectuant des tâches dans le monde réel — un calendrier implicitement rapide cohérent avec le cadrage d’urgence de Shumer. [14] [20]

Demis Hassabis a répété à plusieurs reprises une fourchette AGI autour de 5 à 10 ans, tout en insistant sur des lacunes actuelles comme l’apprentissage continu, la planification à long horizon et la cohérence. [19] [21]

Yann LeCun a soutenu que l’IA de niveau humain est « dans des années, sinon des décennies », et que les paradigmes actuels (en particulier les approches centrées sur les LLM) sont insuffisants sans modèles du monde plus profonds. [22] [23]

Geoffrey Hinton a publiquement donné une large fourchette 5–20 ans avec faible confiance pour un dépassement de l’humain par l’IA, soulignant une incertitude réelle même chez les meilleurs chercheurs. [2]

🧠 Route vers l’AGI — estimations de calendrier par des experts

Conclusion pour 2026-2035 : la thèse « quelques années » de Shumer est plausible pour une automatisation agentique transformatrice d’une grande partie du travail intellectuel (et pour des performances « type AGI » dans des domaines bornés). Une AGI robuste, largement fiable, autonomement auto-dirigée, qui généralise en sécurité dans des environnements ouverts reste bien moins certaine — même sur des calendriers optimistes — car la fiabilité, l’alignement et l’interaction avec le monde physique demeurent des contraintes déterminantes.

Impacts économiques & sur l’emploi

Ce que disent les meilleures données 2024–février 2026 sur l’exposition et la disruption [24]

L’estimation de base la plus citée reste que environ 40 % de l’emploi mondial est exposé à des changements induits par l’IA, avec une exposition plus élevée dans les économies avancées du fait de la prévalence des emplois à tâches cognitives, et un risque substantiel que l’IA aggrave les inégalités sans réponse de politique publique. Ce n’est pas une prévision de « 40 % de chômage », mais c’est un indicateur crédible que le travail intellectuel n’est plus structurellement protégé. [25]

Le Forum économique mondial rapporte que de nombreux employeurs s’attendent à des réductions d’effectifs lorsque l’IA peut automatiser des tâches (p. ex. son rapport 2025 met en avant que 40 % des employeurs s’attendent à réduire les effectifs là où l’IA peut automatiser des tâches), tout en projetant en parallèle des créations et des destructions d’emplois jusqu’en 2030 — autrement dit, un churn et une reclassification davantage qu’une falaise unique. [26]

L’OIT (indice affiné 2025) continue de constater que l’exposition est fortement concentrée dans certains groupes professionnels (notamment le travail administratif/clerical), avec des implications genrées car les femmes sont surreprésentées dans ces rôles dans de nombreuses économies.

👷 Impact de l’IA sur l’emploi par secteur — sélecteur d’année interactif

Pourquoi la « disruption des cols blancs d’ici fin 2026/début des années 2030 » de Shumer est plausible — et pourquoi le calendrier reste incertain

Deux forces tirent en sens opposés : [18]

Les capacités et les incitations s’accélèrent. Des leaders très visibles prédisent désormais ouvertement le remplacement à court terme de larges parts du travail de bureau. Mustafa Suleyman a récemment soutenu que l’IA pourrait atteindre un niveau humain sur la plupart des tâches professionnelles en ~12–18 mois (tel que rapporté), une affirmation [27] [28]

alignée avec l’urgence de Shumer — même si elle s’avère exagérée. Parallèlement, plusieurs déclarations de PDG soulignent le risque pour les cols blancs, surtout pour les postes débutants, souvent plus routiniers et plus faciles à « agentiser ». [22] [29]

Mais la transformation en entreprise est souvent lente et sujette à échec. Le cadrage MIT « GenAI Divide » (largement couvert en 2025) soutient que si l’adoption est répandue, l’intégration transformationnelle dans les workflows est rare, avec de nombreux pilotes qui échouent à produire un impact P&L mesurable. Plusieurs enquêtes à grande échelle montrent aussi un usage déclaré très élevé de l’IA, mais peu de preuves de changements opérationnels profonds dans la plupart des entreprises — suggérant un décalage entre capacité des modèles et déplacement macroéconomique de l’emploi. [22]

Cela crée un schéma réaliste à court terme jusqu’à ~2030 : (1) ralentissements d’embauche et réduction par attrition dans les rôles routiniers de cols blancs, (2) productivité « assistée par agents » augmentant la production par salarié, et (3) vagues de displacement périodiques une fois qu’un petit ensemble de « workflows agents » répétables devient standardisé.

Rentabilité des entreprises dans un scénario de chômage élevé : le piège côté demande

Une préoccupation centrale dans le discours autour de Shumer est : si l’IA remplace les travailleurs, qui achète les produits ? L’économie n’apporte pas une réponse déterministe unique, mais des travaux 2024-2025 clarifient la tension : [30] [31]

Daron Acemoglu soutient que les gains macroéconomiques de productivité liés à l’IA pourraient être modestes sur une décennie selon des hypothèses réalistes basées sur les tâches (à moins que l’IA ne s’étende à de nombreuses tâches et ne soit déployée efficacement), ce qui implique que certains récits de « profits IA » peuvent être prématurés ou inégaux. [32]

Une analyse de l’OCDE présente également des contributions plausibles à la productivité comme significatives mais pas magiques, et souligne l’importance des contraintes de diffusion/adoption. [33]

La modélisation du FMI sur l’adoption de l’IA et les inégalités suggère que les effets sur l’inégalité de patrimoine peuvent être prononcés quand les décisions d’adoption et les rendements du capital concentrent les bénéfices — cohérent avec un monde où les profits peuvent augmenter même si le pouvoir de négociation du travail diminue, au moins pendant un temps. [22]

Donc, l’image de la rentabilité à court terme (2026-2035) est probablement bifurquée : des leaders sectoriels qui réussissent à commoditiser des workflows intensifs en main-d’œuvre peuvent voir leurs marges s’élargir, tandis que beaucoup d’autres entreprises font face à des goulots d’intégration, des risques réputation/qualité, et une fragilité côté demande si les revenus des ménages baissent.

Inégalités et « qui paie » : pourquoi les coûts d’énergie sont un canal direct pour les classes populaires

Avant même toute flambée de chômage, la hausse des charges des ménages peut agir comme des « multiplicateurs silencieux d’inégalités ». Plusieurs indicateurs 2024–février 2026 montrent que la pression sur le coût de l’électricité est réelle — et, point important — liée à la même montée en puissance d’infrastructure qui permet l’échelle IA : [34]

Aux États-Unis, le prix moyen de l’électricité résidentielle a augmenté sur un an (p. ex. hausses rapportées par l’EIA autour de novembre 2025), dépassant l’inflation globale dans plusieurs analyses, ce qui serre les budgets des ménages à faibles revenus qui consacrent une part plus élevée aux services publics. [35]

En Europe, Eurostat montre que les prix de l’électricité des ménages sont restés relativement stables de fin 2024 à début 2025 à des niveaux élevés post-crise, avec une part significative tirée par les coûts de réseau et des structures de subventions/taxes changeantes — précisément les catégories susceptibles d’augmenter à mesure que les mises à niveau du réseau s’accélèrent pour des charges massives comme les data centers. [33]

En bref : si l’économie IA à court terme devient « intensive en capital et en électricité », les classes populaires peuvent être frappées deux fois — par la pression du marché du travail et par des coûts d’énergie/réseau plus élevés qui financent le substrat physique de l’échelle IA.

Course énergie & infrastructures

La « course pour déployer l’IA à l’échelle » est désormais visiblement contrainte — et propulsée — par l’économie physique : production d’électricité, transport, sous-stations/transformateurs, refroidissement/eau, foncier et autorisations. C’est là que « il n’y a pas assez de puissance restante sur le réseau » cesse d’être une métaphore et devient des positions dans les files, des moratoires et des procédures tarifaires.

Le pic de charge : ce que disent les prévisions les plus autorisées pour 2030 et 2035 [9] [36]

L’Agence internationale de l’énergie projette une croissance rapide de la demande électrique des data centers : environ 15 % par an (2024-2030) avec une consommation mondiale des data centers doublant à ~945 TWh d’ici 2030 dans son scénario de base. [37]

Par ailleurs, l’analyse Electricity 2024 de l’AIE a averti que la consommation électrique des data centers/IA/crypto pourrait atteindre >1 000 TWh d’ici 2026 (mondial). [23] [38]

Aux États-Unis, l’Energy Information Administration a prévu des records de consommation d’électricité en 2025 et 2026, en citant explicitement la hausse de la demande des data centers (y compris IA et crypto) comme facteur.

⚡ Demande électrique mondiale des data centers (TWh)

Les contraintes de réseau ne sont pas abstraites : les opérateurs redessinent les règles d’accès autour des data centers

Les opérateurs de réseau et les autorités de fiabilité traitent les « grandes charges » (data centers, hydrogène, électrification) comme un nouveau régime de planification plutôt qu’une demande incrémentale. [4] [39]

Le North American Electric Reliability Corporation dans son Long-Term Reliability Assessment 2024 souligne que les « grandes charges émergentes » comme les data centers (y compris crypto et IA) posent des défis uniques de prévision et de planification, et documente des projections de croissance de la demande structurellement plus élevées. [19] [4]

Dans la région PJM, les prévisions de charge intègrent une croissance tirée par les data centers ; la mise à jour de janvier 2026 de PJM s’attend à ce que le pic estival augmente fortement sur la décennie et au-delà. PJM évolue également vers des règles qui accommodent explicitement (et exigent de fait) des solutions de grande charge comme « apportez votre propre production » et le « connect-and-manage » basé sur la réduction de charge, reflétant que le processus de file d’attente hérité ne peut pas servir rapidement des interconnexions à l’échelle de gigawatts illimités. [22]

En Irlande, où la contrainte réseau est déjà un enjeu de politique nationale, la Commission for Regulation of Utilities a publié une décision le 9 février 2026 mettant à jour la politique de raccordement des data centers — reconnaissant fonctionnellement que la croissance des grands data centers doit être subordonnée aux règles de stabilité du réseau, et formalisant [40] [41]

des contraintes après des années de limitation de facto. Des analystes ont rapporté que les data centers représentaient ~22 % de la consommation électrique de l’Irlande en 2024, illustrant comment « l’infrastructure IA » peut devenir une charge nationale de niveau système, pas un client marginal.

La pile des goulots : transformateurs, sous-stations, transport, refroidissement/eau, foncier

Les blocages les plus immédiats pour l’échelle IA ne sont de plus en plus pas les GPU, mais les équipements réseau et l’implantation :

Un rapport d’un labo gouvernemental américain (NREL, FY2024) note que les services publics font face à des délais de livraison de transformateurs prolongés pouvant aller jusqu’à [42]

~2 ans (une hausse ~4× par rapport à l’avant-2022), et des augmentations de prix de 4–9× ces dernières années, dues aux contraintes de chaîne d’approvisionnement et de matériaux (acier électrique à grains orientés, cuivre/aluminium), à la main-d’œuvre et à la demande accumulée. [43]

Des reportages Reuters en 2025 ont également averti d’un déficit d’approvisionnement en transformateurs, renforçant qu’il s’agit d’une contrainte structurelle, pas d’un problème d’achat mineur. [44]

Les files d’attente de transport et d’interconnexion restent des problèmes pluriannuels. Les réponses de politique publique américaine (réformes d’autorisation DOE ; règles FERC de planification du transport ; plans capex des grandes utilities) sont explicitement présentées comme nécessaires pour répondre à la demande en hausse et au risque de fiabilité. [45]

La saturation locale du réseau laisse déjà des actifs construits inactifs : des reportages depuis Santa Clara (Californie) décrivent de grands data centers achevés mais inutilisés parce que l’utility municipale ne peut pas fournir assez d’électricité avant la fin des upgrades (avec des échéances allant vers 2028). C’est exactement la réalité « pas assez de puissance sur le réseau », opérationnalisée en délais et capital immobilisé. [46] [30]

Le refroidissement et l’eau sont désormais des contraintes politiques. AP a rapporté que Tucson a adopté des ordonnances imposant des plans de conservation et un examen public pour les très grands utilisateurs d’eau après la controverse autour d’un projet de data center ; des restrictions similaires existent dans d’autres municipalités arides. Des enquêtes ont aussi documenté de grandes entreprises technologiques construisant des data centers dans des régions en stress hydrique à l’échelle mondiale, intensifiant le risque d’opposition locale. [47]

Les pressions foncières et le backlash communautaire deviennent de plus en plus déterminants : les conflits autour de l’expansion des data centers en Virginie du Nord (bruit, pollution des générateurs diesel, empiètement sur des sites historiques) montrent que l’implantation peut devenir un combat social et juridique pluriannuel — ralentissant les déploiements même quand le capital est abondant.

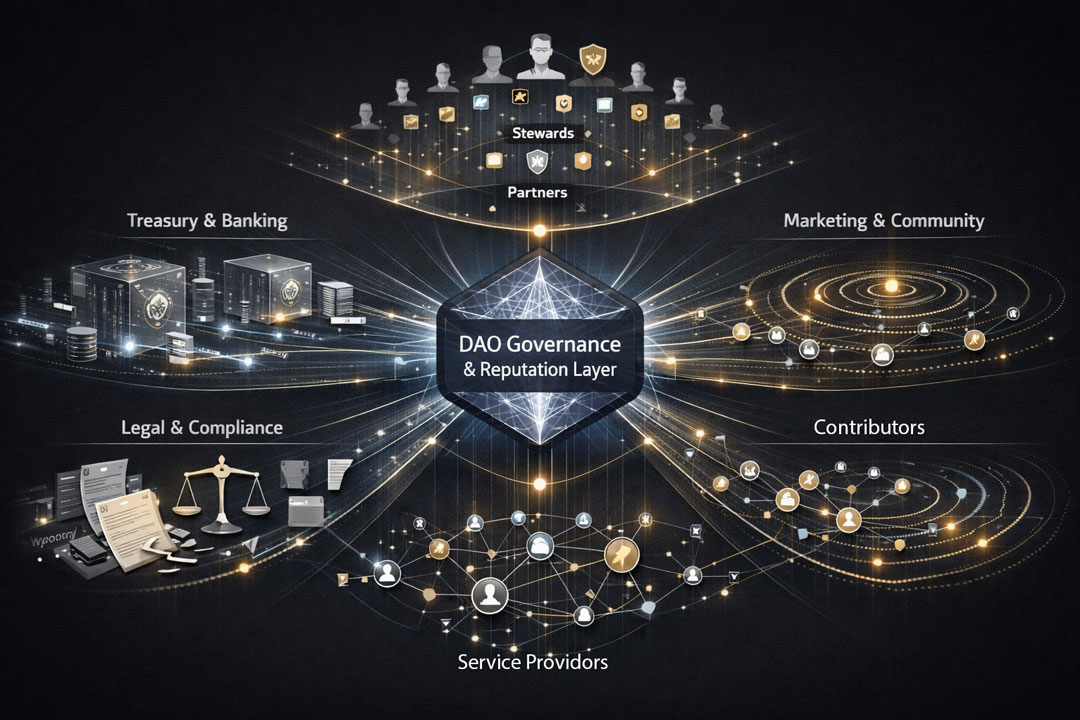

Diagramme causal : comment la « course à la puissance » alimente à la fois l’accélération et le backlash

Cette boucle explique pourquoi l’échelle IA peut sembler « incontrôlée » : les contraintes n’arrêtent pas nécessairement la croissance ; elles la redirigent — hors réseau, relocalisation, dérogations réglementaires — souvent d’une manière qui intensifie les conflits de répartition.

La « course à la puissance » : pourquoi elle accélère l’IA tout en créant des points d’étranglement

La course à la puissance a une structure auto-renforçante : [48] [36]

La demande IA pousse les utilities et les investisseurs à financer de grands programmes d’investissement, souvent justifiés publiquement par la fiabilité et le développement économique. Des reportages Reuters récents montrent des utilities élargissant des plans capex pluriannuels explicitement à cause de la croissance de charge des data centers et d’un intérêt « grande charge » mesuré en dizaines de gigawatts. [4]

Les opérateurs de réseau adaptent les règles de marché pour admettre les grandes charges plus vite, en transférant le risque vers la réduction de charge et l’approvisionnement en production privée. [49]

Ceux qui ont le capital et l’accès politique sécurisent l’électricité en premier, via l’approvisionnement direct, une production dédiée ou des positions avantageuses dans les files — renforçant les fossés compétitifs des fournisseurs IA de pointe. [50]

Les ménages et les petites entreprises peuvent subir une pression tarifaire via les coûts d’expansion du réseau, les marchés de capacité et la dynamique des prix des combustibles — surtout dans les régions contraintes.

C’est pourquoi l’énergie est à la fois un accélérateur (permet l’échelle) et un point d’étranglement (équipements, autorisations, acceptabilité sociale, rareté de l’eau). Cela explique aussi pourquoi la course aux armements est « physique » : la frontière se joue désormais autant sur des mégawatts, des sous-stations et des permis que sur des algorithmes.

Société & capacité d’ajustement

Décalage de vitesse : cycles d’itération des modèles vs institutions humaines

La crainte de Shumer que la société ne puisse pas s’adapter rapidement repose sur un décalage concret : les modèles de pointe peuvent s’améliorer sur des cycles de quelques mois, tandis que l’infrastructure réseau et les mises à jour de gouvernance prennent souvent des années. [42] [13]

L’approvisionnement en transformateurs peut prendre jusqu’à ~2 ans pour de nombreuses utilities (et plus pour de grands transformateurs de puissance selon certains reportages), tandis que les grands projets de transport et de sous-stations peuvent prendre plusieurs années à cause des autorisations et des contraintes d’équipements. Pendant ce temps, les sorties de modèles à l’ère ChatGPT sont désormais souvent espacées de quelques mois, avec de nouvelles fonctions « agentiques » (usage d’outils, usage d’ordinateur, long contexte) arrivant assez vite pour que les contrôles organisationnels accusent un retard.

Des signaux de choc psychologique à court terme sont déjà mesurables [51]

L’anxiété publique n’est pas hypothétique. Un sondage Economist/YouGov du 13–16 février 2026 a rapporté que 63 % des adultes américains s’attendent à ce que les avancées en IA réduisent le nombre d’emplois, tandis qu’une petite minorité seulement s’attend à des augmentations [52]

— une distribution inhabituellement déséquilibrée pour un récit technologique. Un autre sondage YouGov en Grande-Bretagne (18 février 2026) a trouvé de larges majorités s’attendant à un impact modéré ou majeur sur les emplois de cols blancs/professionnels sur 10 ans. [53] [54]

L’incertitude des travailleurs est de plus en plus traitée comme un sujet de santé mentale et de stabilité organisationnelle dans la psychologie et la recherche sur le travail, pas seulement comme un débat tech. L’implication pour 2026-2030 est que même avant un déplacement massif, le stress anticipatoire et la réaction politique peuvent remodeler les marchés du travail (p. ex. plus d’organisation, backlash, volatilité des politiques).

Pourquoi la disruption peut sembler « soudaine » même si elle se construit lentement [22] [25]

Les données d’entreprise suggèrent que beaucoup d’organisations en sont encore au début de l’intégration profonde (expérimentation élevée, transformation faible). Cela peut produire un calme trompeur — jusqu’à ce qu’un nombre relativement petit de « workflows agents » standardisés mûrisse (tri du support client, revue/routage de contrats, rapprochement back-office, maintenance de code), après quoi la diffusion peut s’accélérer rapidement car les entreprises copient les playbooks des autres.

Dimensions juridiques, politiques & géopolitiques

Quand cela devient-il illégal ou interdit ?

Il n’existe pas un « interrupteur » mondial unique où l’AGI devient illégale. À la place, l’illégalité émerge via trois couches :

Couche 1 : usages prohibés (déjà illégaux dans des juridictions clés). [5] [55]

Dans l’UE, l’AI Act est entré en vigueur le 1er août 2024 et suit une application échelonnée ; certaines interdictions sont devenues applicables le 2 février 2025 (p. ex. des pratiques spécifiques à « risque inacceptable »). Cela signifie que certains déploiements d’IA sont déjà illégaux dans l’UE indépendamment du niveau d’avancement du modèle. Le « point d’illégalité » est le moment où un système est utilisé de manière prohibée ou de manière réglementée sans conformité.

Couche 2 : obligations de conformité pour les modèles à usage général/de pointe (devenant exécutoires selon un calendrier). [5] [56]

Les obligations de l’AI Act de l’UE pour les modèles d’IA à usage général commencent avant le régime complet « haut risque », avec des exigences supplémentaires s’appliquant en août 2026 et août 2027 selon les orientations de la Commission et des reportages majeurs. Pour les développeurs de pointe, « illégal » peut signifier ne pas satisfaire aux obligations de transparence/gestion des risques requises une fois en vigueur (même si le modèle lui-même n’est pas interdit).

Couche 3 : sécurité nationale et contrôles transfrontaliers (déjà en expansion). [57]

Les États-Unis n’ont toujours pas une loi fédérale unique et complète sur l’IA à la mi-2025 selon le Congressional Research Service, mais les contrôles à l’export et les restrictions technologiques internationales se sont étendus — couvrant des puces avancées et, dans certains cadres, les poids de modèles et les transactions de calcul haute performance. [58]

Dans ce contexte, « illégal » peut signifier exporter ou transférer une technologie contrôlée, des poids de modèles ou des capacités de calcul restreintes en violation des règles de contrôle des exportations — surtout dans la compétition États-Unis–Chine. [59]

En Chine, la régulation n’est pas un AI Act unifié mais un patchwork en croissance rapide couvrant les systèmes algorithmiques, la « deep synthesis », les services d’IA générative et (notamment) les exigences d’étiquetage des contenus IA/synthétiques avec des dates d’entrée en vigueur définies (p. ex. des mesures d’étiquetage 2025 rapportées comme effectives au 1er septembre 2025). Ainsi, « illégal » peut signifier ne pas respecter des obligations d’étiquetage, de dépôt de sécurité ou de gestion de contenu pour des services d’IA générative publics. [57]

Réponse pratique à votre question : cela devient illégal au moment où un développeur ou un déployeur franchit la frontière juridique spécifique d’une juridiction — pratiques prohibées (UE), exigences de conformité obligatoires une fois en vigueur (UE ; nombreuses lois d’États américains pour des contextes spécifiques ; règles chinoises de service), ou restrictions de contrôle des exportations/sécurité nationale (États-Unis et autres). Les preuves (2024–février 2026) ne montrent pas de probabilité réaliste d’une interdiction générale de « construire une IA avancée » adoptée par les grandes puissances ; le schéma le plus probable à court terme est le durcissement des contraintes autour des usages, de l’audit, de la sécurité, du transfert de calcul/poids et de la responsabilité plutôt qu’une interdiction pure et simple de la catégorie technologique.

Pourquoi les pauses sont irréalistes : la logique de course aux armements est désormais une politique explicite

L’affirmation de Shumer d’une « course aux armements inarrêtable » est fortement soutenue par la manière dont les gouvernements décrivent l’IA : [3]

Le « America’s AI Action Plan » de la Maison-Blanche (10 juillet 2025) affirme explicitement que les États-Unis sont dans une course pour la domination mondiale en IA, présente le leadership comme apportant des bénéfices économiques et militaires, et insiste sur la construction d’une vaste infrastructure IA et de l’énergie pour l’alimenter (« Build, Baby, Build! »). C’est une preuve directe que le cadrage exécutif américain traite l’échelle IA et la construction énergétique comme un impératif national, ce qui mine structurellement la plausibilité de ralentissements volontaires.

Une analyse RAND des incitations États-Unis–RPC dans des problèmes de sécurité nationale liés à l’AGI souligne de fortes incitations à la compétition pour des « armes miracles » et des basculements de puissance systémique même si la coopération peut être [60]

souhaitable dans certains domaines de risque — terrain classique de défection. Quand le gain perçu est une domination stratégique ou la survie, « la coordination est difficile » n’est pas un échec moral ; c’est de la théorie des jeux sous incertitude et défiance. [58] [61]

Les contrôles à l’export et contre-contrôles renforcent la dynamique de course : le gouvernement américain et les rapports CRS décrivent l’extension des contrôles d’exportation des semi-conducteurs et des restrictions technologiques visant à limiter l’accès de la Chine à du calcul avancé permettant l’IA, reflétant que « ralentir l’autre camp » est désormais un levier majeur de gouvernance. Les actions d’application côté Chine et les réponses de chaîne d’approvisionnement (p. ex. contrôle des importations de puces, contrôles sur les terres rares) indiquent aussi une structure d’escalade mutuelle.

Géopolitique de l’énergie comme nouvelle géopolitique de l’IA

Parce que l’échelle est désormais contrainte par l’électricité dans certaines régions, l’énergie devient un intrant stratégique : [4]

Les opérateurs de réseau et les régulateurs redessinent les règles d’accès pour les grandes charges (le « bring-your-own-generation » de PJM ; la politique de raccordement des data centers en Irlande), créant de facto des « licences d’accès à la puissance ». [3]

Les stratégies nationales fusionnent de plus en plus IA et priorités d’infrastructure : des documents de politique américaine lient explicitement la domination IA à l’infrastructure et à l’énergie, tandis que utilities et investisseurs traitent déjà les data centers comme moteurs principaux de capex sur plusieurs décennies. [36]

Cela signifie que même si les percées algorithmiques continuent, les goulots de puissance peuvent façonner l’avantage géopolitique en déterminant quelles régions peuvent héberger la prochaine vague d’entraînement et d’inférence de pointe à grande échelle.

Scénarios équilibrés, incertitudes clés, et enseignements actionnables

Scénarios de court terme jusqu’en 2035 avec probabilités basées sur des preuves

Scénario A : vague de productivité agentique sans « AGI complète » (probabilité ~45 %) [2]

D’ici 2028-2032, les systèmes agentiques deviennent une couche dominante de production de cols blancs (code, opérations back-office, support client, rédaction de conformité, workflows de données) tout en nécessitant une supervision humaine pour les décisions à forts enjeux en raison des limites de fiabilité et d’alignement. C’est cohérent avec (a) de forts signaux de capacité agentique dans les sorties de février 2026, (b) des barrières d’intégration en entreprise et un ROI inégal, et

(c) des modes connus d’effondrement du raisonnement à haute complexité.

Scénario B : « AGI précoce au niveau laboratoire » émerge et diffuse de manière inégale (probabilité ~25 %) [18]

Entre 2027-2031, un ou plusieurs laboratoires démontrent des systèmes qui automatisent de manière fiable une très grande fraction du travail intellectuel à distance dans des environnements contrôlés (p. ex. seuils de type « AI R&D-4 » discutés par les labs), déclenchant des effondrements d’embauche plus marqués côté débutants et une réorganisation rapide dans les secteurs à forte exposition. Ceci est soutenu par les calendriers agressifs évoqués par certains leaders de pointe et par la dynamique de composition interne (modèles accélérant le développement de modèles), mais reste limité par des préoccupations de sécurité et de fiabilité reconnues dans des documents majeurs.

Scénario C : contraintes de puissance et d’autorisations deviennent l’accélérateur dominant (probabilité ~20 %) [4]

De 2026 à 2030, le plus grand goulot n’est pas la qualité des modèles mais les mégawatts : retards d’interconnexion, achat de transformateurs/sous-stations, contraintes de transport, conflits eau/terrain, et moratoires régionaux forcent le calcul à se relocaliser et ralentissent la borne supérieure de l’échelle dans des hubs clés. L’IA progresse toujours, mais la « vitesse d’échelle » devient dépendante de la géographie et de l’infrastructure et plus intensive en capital — favorisant les incumbents et les projets soutenus par des États. Cela s’aligne avec les changements de règles des opérateurs, les avertissements NERC sur la demande, les délais de transformateurs, et la capacité de data centers immobilisée faute de puissance.

Scénario D : un incident majeur entraîne un durcissement réglementaire partiel sans mettre fin à la course (probabilité ~10 %) [3]

Un échec très médiatisé (p. ex. incident cyber sévère impliquant un mésusage de modèle, grande vague de fraude, ou perturbation d’infrastructure critique liée à des outils IA) déclenche un durcissement réglementaire rapide : licence plus stricte pour les modèles à haute capacité, reporting obligatoire, régimes de responsabilité renforcés, et/ou extension des contrôles à l’export. Cependant, les incitations de course aux armements maintiennent le développement — la régulation change où et comment l’échelle se fait plutôt que d’arrêter la technologie. Cela correspond à la combinaison de (a) cadrage de politique explicite « gagner la course », et (b) architectures de conformité existantes (application échelonnée UE ; contrôles export) extensibles rapidement après des chocs.

Incertitudes clés qui dominent les résultats 2026-2035 [12]

L’incertitude centrale est de savoir si la fiabilité et l’alignement s’améliorent aussi vite que la capacité. Les résultats Apple sur « l’effondrement à haute complexité » et l’accent continu d’OpenAI sur la réduction des hallucinations impliquent que « meilleur que l’humain sur la plupart des tâches » n’est pas garanti à court terme sans changements d’architecture. [42]

La deuxième est le débit d’infrastructure : capacité de fabrication de transformateurs, vitesse de construction du réseau, acceptation politique locale, et contraintes d’eau/refroidissement peuvent plafonner l’échelle même si l’argent est abondant. [58]

La troisième est la géopolitique : contrôles à l’export, contraintes terres rares, et initiatives de « souverain AI » peuvent rediriger l’échelle géographiquement, augmenter les coûts et renforcer la dynamique de course.

Enseignements actionnables pour individus, entreprises et décideurs [62]

Pour les individus (2026-2030), le levier le plus fort est de devenir « agent-native » dans votre domaine — apprendre à définir des résultats, superviser des agents, et vérifier les sorties — car le plus grand déplacement de travail à court terme est probablement au sein des emplois (redesign de tâches, moins de juniors, plus de production par employé) avant la « disparition totale des emplois ». [22]

Pour les entreprises, éviter le piège de mesurer la valeur de l’IA uniquement via l’adoption de pilotes. Les preuves suggèrent que la qualité d’intégration et la refonte des workflows — pas l’accès au modèle en soi — déterminent le ROI. Construire tôt la vérification, l’auditabilité et des contrôles de sécurité, surtout pour l’usage agentique d’outils (exécution de code, contrôle navigateur, ops financières).

Pour les décideurs, les « leviers de stabilité » les plus rapides ne sont pas des interdictions spéculatives d’AGI mais : (1) protections ciblées pour les travailleurs à forte exposition ; (2) règles de responsabilité et de transparence pour les déploiements à forts enjeux ; (3) politique industrielle réseau/équipements (transformateurs, sous-stations, transport) évitant que la construction d’infrastructure IA socialise les coûts sur les ménages ; et (4) contrôles export coordonnés et [24]

standards de sécurité réduisant les incitations à la défection dans les pires cas — en reconnaissant qu’une coordination parfaite est improbable. [19]

Conseils de suivi énergie/infrastructure (signal fort pour 2026-2030) : surveiller (a) les prévisions de charge et changements de règles « grande charge » des principaux opérateurs de réseau (p. ex. PJM), (b) les évaluations de fiabilité (NERC), (c) les délais et indicateurs de prix des transformateurs (NREL/industrie), (d) les moratoires locaux sur les data centers et ordonnances eau, et (e) les procédures tarifaires des utilities qui transfèrent les coûts d’upgrade du réseau aux ménages. Ce sont des indicateurs avancés de là où l’échelle IA va accélérer — et là où elle va casser en premier.

Pont de transition : l’analyse long terme doit être ancrée sur un petit ensemble de faits de court terme désormais des preuves dures (pas de la spéculation) : (1) les modèles agentiques de pointe livrés en février 2026 sont explicitement conçus pour l’usage d’outils sur longue durée et sont utilisés dans des boucles de R&D, créant une pression d’itération cumulative ; [7]

(2) des leaders majeurs discutent publiquement de 2026-2027 comme fenêtre plausible pour une capacité « pays de génies », tandis que des sceptiques évoquent encore des horizons de plusieurs années à plusieurs décennies, indiquant une incertitude extrême ; (3) le cadrage sécurité nationale américain (« gagner la course IA ») rend des pauses mondiales structurellement improbables, intensifiant les incitations à la défection États-Unis–Chine ; (4) la demande d’électricité des data centers est prévue en forte hausse jusqu’en 2030, et les opérateurs/régulateurs changent déjà les règles car la capacité est contrainte ; (5) des goulots physiques — transformateurs/sous-stations, transport, eau, foncier, autorisations — deviennent le facteur limitant de l’échelle IA, et ces mêmes contraintes peuvent augmenter les coûts d’énergie des ménages et approfondir les inégalités.

📊 Explorer les visualisations de données interactives

Voir les 5 visualisations en mode plein écran avec des curseurs d’année interactifs et des vues basculables

Voir les graphiques interactifs →

Sources & références

📊 Explorer les visualisations de données interactives

Voir les 5 visualisations en mode plein écran avec des curseurs d’année interactifs et des vues basculables

Voir les graphiques interactifs →- Matt Shumer — « Something Big Is Happening »

- OpenAI — Fiche système GPT-5.3-Codex (PDF)

- Maison-Blanche — America’s AI Action Plan

- Reuters — Accords d’électricité PJM pour data centers (février 2026)

- Commission européenne — FAQ AI Act de l’UE

- Business Insider — Gary Marcus sur l’essai de Shumer

- OpenAI — Présentation de GPT-5.3-Codex

- Anthropic — Sortie de Claude Opus 4.6

- Anthropic — Rapport de risques Claude Opus 4.6

- OpenAI — Présentation de GPT-5

- OpenAI — Pourquoi les modèles de langage hallucinent

- Apple Research — « The Illusion of Thinking »

- Sam Altman — « The Gentle Singularity »

- Boston Dynamics — Annonce du nouveau robot Atlas

- BMW Group — Essais de robots humanoïdes

- Reuters — Mercedes-Benz investit dans Apptronik

- arXiv — OpenVLA : modèle vision-langage-action open source

- Anthropic — Déclaration au Paris AI Summit

- PJM Interconnection — Prévision de croissance de charge

- Time — Entretien avec Demis Hassabis

- El País — Yann LeCun sur l’IA de niveau humain

- MLQ — Rapport « State of AI in Business 2025 »

- Geoffrey Hinton — Déclaration sur le risque IA

- FMI — L’IA va transformer l’économie mondiale

- WEF — Future of Jobs 2025

- OIT — IA générative et emplois : indice d’exposition professionnelle

- Tom’s Hardware — Le patron IA de Microsoft sur les cols blancs

- Axios — Calendrier IA de Dario Amodei

- McKinsey — State of AI 2025

- The Guardian — Data centers et usage de l’eau

- Daron Acemoglu (MIT) — « The Simple Macroeconomics of AI »

- OCDE — Évaluation macroéconomique des gains de productivité IA

- FMI — Document de travail : IA et marchés du travail (2025)

- Utility Dive — Hausse des prix du gaz et de l’électricité

- Eurostat — Données sur les prix de l’énergie

- AIE — Rapport « Energy and AI »

- AIE — Electricity 2024

- Reuters — Records de consommation électrique US

- NERC — Long-Term Reliability Assessment 2024

- CRU Irlande — Politique de raccordement des data centers

- KPMG Irlande — Réinitialisation de la politique data centers

- NREL — Délais des transformateurs et infrastructure réseau

- Reuters — Déficit d’approvisionnement en transformateurs US

- US DOE — Règle finale d’autorisation de transport

- Tom’s Hardware — Data centers à l’arrêt en attente de puissance réseau

- AP News — Impacts communautaires des data centers

- Business Insider — Data centers en Virginie du Nord

- Reuters — Southern Co. augmente son plan de dépenses

- Reuters — Les investissements réseau US décollent

- Financial Times — IA et infrastructure énergétique

- YouGov/Economist — Les Américains sur l’IA et l’emploi (février 2026)

- YouGov UK — Sondage économie/IA

- American Psychological Association — Tendances d’incertitude au travail

- The Guardian — IA, travail et futur

- Le Monde — Premières mesures de l’AI Act de l’UE

- Reuters — Les règles IA de l’UE avancent, pas de pause

- Congressional Research Service — Data centers et IA (R48555)

- Congressional Research Service — Réseau/énergie et IA (R48642)

- Technology’s Legal Edge — Étiquetage des contenus IA en Chine

- RAND — Course IA US-Chine comme dilemme du prisonnier

- Financial Times — Investissements infrastructure IA

- Business Insider — Le CEO d’Anthropic sur les emplois d’ingénierie