Aceleração da IA, a "Corrida pelo Poder" e Risco de Choque Societal a Curto Prazo até 2035 (Parte 1: Visão de Curto Prazo)

Resumo executivo [1] [2] [3] [4] [5]

O ensaio de Matt Shumer de fevereiro de 2026, “Something Big Is Happening”, argumenta que ocorreu uma mudança perceptível para um modo de “urgência máxima” porque os laboratórios na fronteira estão agora a entregar modelos agentes capazes de executar trabalho de longa duração com ferramentas e — ponto crucial — estão a ser usados dentro dos ciclos de I&D dos próprios criadores, acelerando a iteração rumo a capacidades do tipo AGI (ou além) a um ritmo que a maioria das instituições não consegue absorver. Um “reality check” de curto prazo (fevereiro de 2026) confirma o vetor de “aceleração” — sobretudo em código, fluxos agentivos e trabalho intelectual profissional — mas ainda mostra limites duros em fiabilidade, em raciocínio exato de alta complexidade e em operação autónoma segura sem guardrails. O motor mais “imparável” não é apenas a pressão comercial, mas o enquadramento explícito de segurança nacional da competição EUA–China: os principais governos descrevem a liderança em IA como domínio estratégico, o que cria fortes incentivos à deserção (dinâmicas de corrida) e enfraquece a plausibilidade de pausas significativas. A restrição de curto prazo — e acelerador — subestimada é a energia e a infraestrutura física: capacidade da rede, filas de interligação, transformadores/subestações, licenciamento de linhas, arrefecimento/água, implantação em terreno, e estruturas de abastecimento energético (p. ex., “traga a sua própria geração”) que estão a determinar cada vez mais quem consegue escalar IA e onde. No plano jurídico, uma “IA tornar-se ilegal” no sentido global é pouco provável até 2035; em vez disso, o sistema torna-se ilegal por usos específicos, contextos de implantação, falhas de segurança/conformidade e controlos transfronteiriços — com “linhas vermelhas” de curto prazo já ativas na UE (práticas proibidas desde fevereiro de 2025; obrigações faseadas para modelos de finalidade geral até agosto de 2026/2027), e regimes crescentes de controlo de exportações e regulamentação por estados nos EUA, tudo complicado pela corrida armamentista.

Fonte âncora [1]

Matt Shumer publicou “Something Big Is Happening” por volta de 9 de fevereiro de 2026 e apresentou-o como um ponto de inflexão geracional — comparando explicitamente o momento ao reconhecimento de que “algo enorme” está a acontecer e que a maioria das pessoas continua a agir como se a mudança ainda estivesse a anos de distância. A sua afirmação central é que lançamentos recentes na fronteira (ele destaca explicitamente lançamentos de modelos de 5 de fevereiro) tornaram inegável para ele que a IA está a avançar para uma era em que pode executar trabalho significativo com supervisão humana mínima, incluindo tarefas que exigem “julgamento / gosto” e não apenas autocompletar. [1]

O “soco no estômago” mais viral de Shumer é a mudança vivida nos fluxos de trabalho: “Já não sou necessário para o trabalho técnico em si. Eu descrevo o resultado que quero e ele aparece.” Ele argumenta que isto não é um truque de um nicho de programadores, mas um prenúncio de uma deslocação massiva do trabalho de colarinho branco assim que as organizações reconfigurarem os seus processos em torno de sistemas agentes. [6]

Quanto à viralidade e ao alcance mais amplo, grandes meios relataram que o ensaio se espalhou rapidamente nas redes sociais e foi repercutido pela imprensa de negócios; um artigo descreveu que atingiu dezenas de milhões de visualizações (p. ex., “mais de 80 milhões de visualizações” no X, conforme a recolha/momento de medição), indicando que serviu como um “wake-up call” público e não apenas como um post técnico. [1]

Shumer ancora a viragem para urgência nos lançamentos de 5 de fevereiro: o modelo de codificação agentiva da OpenAI (GPT-5.3-Codex) e o novo flagship da Anthropic (Claude Opus 4.6), que ele apresenta como prova de que “as capacidades chegaram” e que as consequências económicas e geopolíticas estão agora num relógio de curto prazo (2026-início dos anos 2030), não num futuro distante. [7]

Ele também destaca um ciclo de feedback: os laboratórios na fronteira estão a usar cada vez mais modelos de ponta para acelerar a criação, a avaliação, a implantação e o trabalho de segurança em torno dos próximos modelos — uma dinâmica interna de “composição” que (se continuar) comprime cronogramas.

🚀 Escalonamento do compute de treino em IA — dados históricos & projeções divergentes até 2035 (escala log)

Verificação de realidade tecnológica

Como é, na prática, a “capacidade de fevereiro de 2026” [2] [7]

Programação agentiva e fluxos de trabalho orientados por ferramentas são o salto mais nítido. O system card do GPT-5.3-Codex da OpenAI descreve-o como o modelo de codificação agentiva mais capaz que já entregou, concebido para tarefas de longa duração envolvendo pesquisa, uso de ferramentas e execução complexa, e observa que pode ser guiado “como um colega” sem perder o contexto. A OpenAI também assinala um ponto interno de viragem: é o primeiro system card a descrever um modelo de ponta como “instrumental” na sua própria criação (via versões anteriores usadas em fluxos de desenvolvimento), o que constitui uma versão concreta e estreita de “autoaperfeiçoamento recursivo” (dirigido por humanos, mediado por ferramentas, mas cumulativo). [2]

A postura de segurança em fevereiro de 2026 reconhece implicitamente crescimento perigoso de capacidades. A OpenAI afirma que o GPT-5.3-Codex é tratado como “alta capacidade” em biologia e (por precaução) “alta capacidade” em cibersegurança no âmbito do seu Preparedness Framework, ao mesmo tempo que declara que ele não atinge o nível de “alta capacidade” em autoaperfeiçoamento de IA. Esta combinação importa: sugere que o risco de curto prazo é menos “o modelo a melhorar-se a si próprio de forma autónoma” e mais “o modelo a aumentar materialmente a capacidade humana (e organizacional) em domínios de alto risco”, em particular operações cibernéticas. [2]

Quantitativamente, o salto é visível em pelo menos algumas avaliações cibernéticas internas. No system card da OpenAI, o GPT-5.3-Codex supera os modelos de comparação listados anteriormente numa taxa de sucesso combinada “Cyber Range” (80% vs bases mais fracas). Mesmo tratando avaliações internas com cautela, a direção é consistente com relatos de que defesa e ataque cibernético estão entre as aplicações “agentivas” que evoluem mais rápido. [8] [9]

Do lado da Anthropic, o Claude Opus 4.6 é apresentado como um modelo híbrido de raciocínio com “capacidades avançadas em trabalho intelectual, código e agentes”, e a Anthropic cita bons resultados em benchmarks de trabalho profissional nos seus materiais de lançamento. O enquadramento pós-lançamento sobre “risco de sabotagem” é particularmente revelador: define “sabotagem” como uma alteração ou manipulação autónoma dos sistemas/decisões de uma organização que aumenta o risco catastrófico e — embora conclua que o risco global é “muito baixo mas não negligenciável” — observa explicitamente que o Opus 4.6 é amplamente usado na Anthropic para código, geração de dados e casos de uso agentivos.

“Julgamento/gosto” e tomada de decisão autónoma: o que é real vs o que é hype [10] [11]

O enquadramento de Shumer sobre “julgamento/gosto” corresponde a duas tendências mensuráveis: (1) melhor seguimento de instruções e redução de alucinações nos novos modelos de ponta, e (2) comportamento de longo horizonte mais coerente sob uso de ferramentas. A OpenAI trata explicitamente alucinações como um desafio fundamental persistente, mesmo ao reportar reduções na família GPT-5. [12]

Mas ainda há colapsos de fiabilidade sob certas formas de complexidade, especialmente raciocínio algorítmico/exato. Uma linha de investigação da Apple amplamente citada (“The Illusion of Thinking”, junho de 2025) conclui que “modelos de raciocínio” podem mostrar vantagem em complexidade média mas sofrer “colapso completo” em complexidade mais alta, com raciocínio inconsistente e falha em aplicar algoritmos explícitos de forma fiável. Isto é um contrapeso importante aos relatos “AGI em um ano”: muitas tarefas economicamente úteis exigem não apenas texto plausível, mas execução fiável perante casos limite, restrições variáveis e condições adversariais.

Robótica e agência física: a “ponte” 2026–2030 que determina a velocidade da disrupção no mundo real [13]

Na janela de curto prazo que Shumer enfatiza, robôs importam porque convertem capacidades cognitivas em agência física, estendendo a automação do “trabalho de ecrã” para logística, manufatura e, eventualmente, serviços.

Vários sinais entre 2024 e fevereiro de 2026 mostram que a pilha incorporada (embodied stack) está a avançar, ainda que de forma desigual: [14]

A Boston Dynamics declarou no início de 2026 que está a iniciar a fabricação de uma versão produto do seu humanoide Atlas, com implantações em 2026 previstas na Hyundai e na Google DeepMind, e que o Atlas será treinado via novas abordagens de modelos fundacionais para tarefas industriais. [15]

A BMW reportou em setembro de 2024 que o humanoide Figure 02, da Figure, está a ser testado na fábrica do BMW Group em Spartanburg num ambiente real de produção, com especificações físicas indicadas (altura, peso, capacidade de carga), sinalizando adoção piloto “de fábrica” precoce. [16]

A Reuters reportou em 2025 que a Mercedes-Benz investiu na Apptronik e testou humanoides “Apollo” nas suas fábricas, descrevendo uma trajetória em que a teleoperação primeiro demonstra tarefas que o robô depois aprende a executar com maior autonomia. [17]

Do lado da investigação, trabalhos de 2024–2025 sobre políticas robóticas generalistas (p. ex., OpenVLA treinado em ~970k demonstrações robóticas reais; datasets Open X-Embodiment permitindo transferência entre robôs) indicam uma tentativa real de “LLM-izar” a robótica via escala visão-linguagem-ação — reconhecendo abertamente desafios de adoção e a necessidade de fine-tuning e generalização eficientes. [14]

A previsão robótica mais credível a curto prazo não é “humanoides por todo o lado até 2027”, mas sim: a disrupção começa pelo trabalho de ecrã (2026–2030), e a disrupção do trabalho físico acelera à medida que robôs se tornam mais fiáveis, mais baratos e mais fáceis de implantar em ambientes constrangidos (fábricas, armazéns) antes de ambientes abertos. Isto corresponde ao padrão dos pilotos industriais (BMW/Figure; Mercedes/Apptronik; implantações 2026 previstas pela Boston Dynamics) em vez de uma explosão súbita de robôs de consumo.

Intervalos de calendário de especialistas (2026–2035) vs a urgência “poucos anos” de Shumer

Visões “AGI em breve” a curto horizonte são agora expressas por vários líderes de ponta, mas com reservas importantes e ambiguidade de definição: [18]

Dario Amodei escreveu em fevereiro de 2025 que “possivelmente até 2026 ou 2027” as capacidades de IA poderiam assemelhar-se a um “país de génios num datacenter”, destacando urgência e implicações de escala nacional. [19] [13]

Sam Altman, em junho de 2025, previu uma progressão por etapas: 2025 como a chegada de agentes que fazem trabalho cognitivo real, 2026 como sistemas que encontram “ideias novas”, e 2027 como robôs a executar tarefas no mundo real — um cronograma implicitamente rápido consistente com o enquadramento de urgência de Shumer. [14] [20]

Demis Hassabis repetiu em várias ocasiões um intervalo de AGI de 5 a 10 anos, insistindo em lacunas atuais como aprendizagem contínua, planeamento de longo horizonte e consistência. [19] [21]

Yann LeCun argumentou que IA de nível humano está “a anos, senão décadas” de distância, e que os paradigmas atuais (em particular abordagens centradas em LLMs) são insuficientes sem modelos de mundo mais profundos. [22] [23]

Geoffrey Hinton deu publicamente um intervalo amplo de 5–20 anos com baixa confiança para a IA ultrapassar o humano, enfatizando incerteza real mesmo entre os melhores investigadores. [2]

🧠 Rota para a AGI — estimativas de calendário por especialistas

Conclusão para 2026–2035: a tese “poucos anos” de Shumer é plausível para automação agentiva transformadora de grande parte do trabalho intelectual (e para desempenho “tipo AGI” em domínios delimitados). Uma AGI robusta, amplamente fiável, autonomamente auto-dirigida, que generaliza com segurança em ambientes abertos continua muito menos certa — mesmo em cronogramas otimistas — porque fiabilidade, alinhamento e interação com o mundo físico permanecem restrições determinantes.

Impactos económicos & emprego

O que dizem os melhores dados 2024–fevereiro de 2026 sobre exposição e disrupção [24]

A estimativa-base mais citada continua a ser que cerca de 40% do emprego global está exposto a mudanças induzidas por IA, com maior exposição nas economias avançadas devido à prevalência de empregos com tarefas cognitivas, e com risco material de a IA agravar desigualdades sem resposta de política pública. Isto não é uma previsão de “40% de desemprego”, mas é um indicador credível de que trabalho intelectual já não está estruturalmente protegido. [25]

O Fórum Económico Mundial reporta que muitos empregadores esperam reduções de headcount quando a IA pode automatizar tarefas (p. ex., o seu relatório de 2025 destaca que 40% dos empregadores esperam reduzir efetivos onde a IA automatiza tarefas), ao mesmo tempo projetando criações e destruições de empregos até 2030 — isto é, churn e reclassificação mais do que um único precipício. [26]

A OIT (índice refinado de 2025) continua a concluir que a exposição está altamente concentrada em certos grupos profissionais (notavelmente trabalho administrativo/clerical), com implicações de género porque as mulheres estão sobrerrepresentadas nesses cargos em muitas economias.

👷 Impacto da IA no emprego por setor — seletor de ano interativo

Porque a “disrupção de colarinhos brancos até ao fim de 2026/início dos anos 2030” de Shumer é plausível — e porque o calendário continua incerto

Duas forças puxam em direções opostas: [18]

Capacidades e incentivos aceleram. Líderes muito visíveis agora preveem abertamente substituição a curto prazo de grandes fatias de trabalho de escritório. Mustafa Suleyman afirmou recentemente que a IA poderá atingir nível humano na maioria das tarefas profissionais em ~12–18 meses (conforme reportado), uma afirmação [27] [28]

alinhada com a urgência de Shumer — ainda que possa ser exagerada. Em paralelo, várias declarações de CEOs sublinham o risco para colarinhos brancos, especialmente em cargos júnior, tipicamente mais rotineiros e mais fáceis de “agentificar”. [22] [29]

Mas a transformação empresarial é frequentemente lenta e falha. O enquadramento MIT “GenAI Divide” (amplamente coberto em 2025) argumenta que, embora a adoção seja ampla, a integração transformadora nos workflows é rara, com muitos pilotos a não entregarem impacto mensurável em P&L. Vários inquéritos de grande escala também mostram uso declarado muito alto de IA, mas pouca evidência de mudanças operacionais profundas na maioria das empresas — sugerindo um gap entre capacidade dos modelos e deslocação macroeconómica do emprego. [22]

Isto cria um padrão realista de curto prazo até ~2030: (1) abrandamento de contratações e redução por atrito em funções rotineiras de colarinhos brancos, (2) produtividade “assistida por agentes” aumentando a produção por trabalhador, e (3) vagas periódicas de substituição à medida que um pequeno conjunto de “workflows agentes” repetíveis se torna padronizado.

Rentabilidade empresarial num cenário de alto desemprego: a armadilha do lado da procura

Uma preocupação central no discurso em torno de Shumer é: se a IA substitui trabalhadores, quem compra os produtos? A economia não oferece uma resposta determinista única, mas trabalhos de 2024–2025 clarificam a tensão: [30] [31]

Daron Acemoglu argumenta que os ganhos macroeconómicos de produtividade da IA podem ser modestos numa década sob suposições realistas baseadas em tarefas (a menos que a IA se expanda para muitas tarefas e seja implantada de forma eficaz), implicando que alguns relatos de “lucros de IA” podem ser prematuros ou desiguais. [32]

Uma análise da OCDE também apresenta contribuições plausíveis para produtividade como significativas mas não mágicas, e sublinha a importância das restrições de difusão/adoção. [33]

A modelação do FMI sobre adoção de IA e desigualdade sugere que os efeitos sobre desigualdade de riqueza podem ser pronunciados quando decisões de adoção e retornos do capital concentram benefícios — consistente com um mundo onde lucros podem subir mesmo com queda do poder de barganha do trabalho, pelo menos por algum tempo. [22]

Logo, a imagem de curto prazo (2026–2035) é provavelmente bifurcada: líderes setoriais que conseguem comoditizar workflows intensivos em mão-de-obra podem ver margens alargar, enquanto muitas outras empresas enfrentam gargalos de integração, riscos reputacionais/qualidade e fragilidade do lado da procura se rendimentos dos agregados familiares caírem.

Desigualdade e “quem paga”: porque custos de energia são um canal direto para as classes populares

Mesmo antes de qualquer pico de desemprego, aumentos de custos para famílias podem atuar como “multiplicadores silenciosos” de desigualdade. Vários indicadores 2024–fevereiro de 2026 mostram que a pressão no custo da eletricidade é real — e, crucialmente, ligada ao mesmo ramp-up de infraestrutura que permite escala em IA: [34]

Nos EUA, o preço médio residencial de eletricidade subiu em termos anuais (p. ex., aumentos reportados pela EIA por volta de novembro de 2025), superando a inflação geral em várias análises, apertando orçamentos de famílias de baixos rendimentos que dedicam parcela maior a utilities. [35]

Na Europa, a Eurostat mostra que os preços de eletricidade para consumidores domésticos permaneceram relativamente estáveis do fim de 2024 ao início de 2025 em níveis elevados pós-crise, com uma parcela significativa vinda de custos de rede e estruturas de subsídios/taxas em mudança — precisamente as categorias propensas a aumentar à medida que upgrades de rede aceleram para cargas massivas como data centers. [33]

Em suma: se a economia da IA a curto prazo se tornar “intensiva em capital e eletricidade”, classes populares podem ser atingidas duas vezes — pela pressão no mercado de trabalho e por custos de energia/rede mais altos que financiam o substrato físico da escala em IA.

Corrida de energia & infraestruturas

A “corrida para implantar IA à escala” está agora visivelmente constrangida — e impulsionada — pela economia física: geração elétrica, transmissão, subestações/transformadores, arrefecimento/água, terreno e licenças. É aqui que “não há energia suficiente na rede” deixa de ser metáfora e vira posições em filas, moratórias e processos tarifários.

Pico de carga: o que dizem as previsões mais autorizadas para 2030 e 2035 [9] [36]

A Agência Internacional de Energia projeta crescimento rápido da procura elétrica de data centers: cerca de 15% ao ano (2024–2030), com o consumo global de data centers a duplicar para ~945 TWh até 2030 no seu cenário-base. [37]

Além disso, a análise Electricity 2024 da AIE alertou que consumo de eletricidade de data centers/IA/cripto poderia alcançar >1.000 TWh até 2026 (global). [23] [38]

Nos EUA, a Energy Information Administration previu recordes de consumo elétrico em 2025 e 2026, citando explicitamente o aumento de procura de data centers (incluindo IA e cripto) como fator.

⚡ Procura elétrica global de data centers (TWh)

As restrições de rede não são abstratas: operadores estão a redesenhar regras de acesso por causa de data centers

Operadores de rede e autoridades de fiabilidade estão a tratar “grandes cargas” (data centers, hidrogénio, eletrificação) como um novo regime de planeamento, e não como procura incremental. [4] [39]

A North American Electric Reliability Corporation, no seu Long-Term Reliability Assessment 2024, destaca que “grandes cargas emergentes” como data centers (incluindo cripto e IA) criam desafios únicos de previsão e planeamento, e documenta projeções de crescimento de procura estruturalmente mais elevadas. [19] [4]

Na região PJM, as previsões de carga já incorporam crescimento impulsionado por data centers; a atualização de janeiro de 2026 da PJM espera que o pico de verão aumente fortemente na década e além. A PJM também está a avançar para regras que acomodam explicitamente (e na prática exigem) soluções de grande carga como “traga a sua própria geração” e “connect-and-manage” baseado em redução de carga, refletindo que o processo de fila de interligação herdado não consegue servir rapidamente interligações à escala de gigawatts sem limites. [22]

Na Irlanda, onde a restrição de rede já é questão de política nacional, a Commission for Regulation of Utilities publicou uma decisão em 9 de fevereiro de 2026 atualizando a política de ligação de data centers — reconhecendo, na prática, que o crescimento de grandes data centers deve ser subordinado a regras de estabilidade da rede, e formalizando [40] [41]

restrições após anos de limitação de facto. Analistas reportaram que data centers representaram ~22% do consumo elétrico da Irlanda em 2024, ilustrando como “infraestrutura de IA” pode tornar-se uma carga nacional de nível sistémico, e não um cliente marginal.

A pilha de gargalos: transformadores, subestações, transmissão, arrefecimento/água, terreno

Os bloqueios mais imediatos para escalar IA já não são cada vez mais as GPUs, mas equipamentos de rede e implantação:

Um relatório de um laboratório governamental dos EUA (NREL, FY2024) observa que utilities enfrentam prazos de entrega prolongados de transformadores que podem ir até [42]

~2 anos (um aumento ~4× face ao pré-2022), e aumentos de preço de 4–9× nos últimos anos, devido a restrições de cadeia de abastecimento e materiais (aço elétrico de grão orientado, cobre/alumínio), mão-de-obra e procura acumulada. [43]

Reportagens da Reuters em 2025 também alertaram para défice de oferta de transformadores, reforçando que isto é uma restrição estrutural, e não um problema menor de compras. [44]

Filas de transmissão e interligação continuam a ser problemas multi-anuais. Respostas de política pública nos EUA (regras de licenciamento do DOE; regras da FERC de planeamento de transmissão; planos de capex das principais utilities) são explicitamente apresentadas como necessárias para responder ao aumento de procura e ao risco de fiabilidade. [45]

A saturação local de rede já está a deixar ativos construídos ociosos: relatos de Santa Clara (Califórnia) descrevem grandes data centers concluídos mas não utilizados porque a utility municipal não consegue fornecer eletricidade suficiente até ao fim de upgrades (com prazos a apontar para 2028). Isto é exatamente a realidade “não há energia suficiente na rede”, operacionalizada em atrasos e capital imobilizado. [46] [30]

Arrefecimento e água já são restrições políticas. A AP reportou que Tucson aprovou ordens exigindo planos de conservação e escrutínio público para utilizadores de água muito grandes após controvérsia em torno de um projeto de data center; restrições semelhantes existem noutras localidades áridas. Investigações também documentaram grandes empresas tecnológicas a construir data centers em regiões sob stress hídrico globalmente, intensificando o risco de oposição local. [47]

Pressões de terreno e backlash comunitário estão a tornar-se determinantes: conflitos em torno da expansão de data centers no Norte da Virgínia (ruído, poluição de geradores a diesel, impacto em locais históricos) mostram que a implantação pode virar uma batalha social e jurídica de vários anos — atrasando implantações mesmo quando capital é abundante.

Diagrama causal: como a “corrida pela energia” alimenta aceleração e backlash

Este loop explica por que a escala em IA pode parecer “fora de controlo”: restrições não necessariamente travam o crescimento; elas redirecionam — off-grid, relocalização, exceções regulatórias — muitas vezes de forma que intensifica conflitos distributivos.

A “corrida pela energia”: por que acelera a IA e ao mesmo tempo cria pontos de estrangulamento

A corrida pela energia tem uma estrutura auto-reforçadora: [48] [36]

A procura de IA empurra utilities e investidores a financiar grandes programas de investimento, muitas vezes justificados publicamente por fiabilidade e desenvolvimento económico. Reportagens recentes da Reuters mostram utilities a ampliar planos de capex multi-anuais explicitamente por causa do crescimento de carga de data centers e interesse de “grandes cargas” medido em dezenas de gigawatts. [4]

Operadores de rede adaptam regras de mercado para admitir grandes cargas mais depressa, transferindo risco para redução de carga e fornecimento de geração privada. [49]

Quem tem capital e acesso político assegura eletricidade primeiro, via procurement direto, geração dedicada ou posições vantajosas nas filas — ampliando fossos competitivos dos fornecedores de IA na fronteira. [50]

Famílias e pequenas empresas podem sofrer pressão tarifária via custos de expansão de rede, mercados de capacidade e dinâmica de preços de combustíveis — sobretudo em regiões constrangidas.

Por isso energia é simultaneamente acelerador (permite escala) e gargalo (equipamentos, licenciamento, aceitação social, escassez de água). Isto também explica por que a corrida armamentista é “física”: a fronteira já se decide tanto por megawatts, subestações e licenças quanto por algoritmos.

Sociedade & capacidade de adaptação

Desfasamento de velocidade: ciclos de iteração de modelos vs instituições humanas

O receio de Shumer de que a sociedade não consiga adaptar-se rápido assenta num desfasamento concreto: modelos de ponta podem melhorar em ciclos de poucos meses, enquanto infraestrutura de rede e atualizações de governação frequentemente levam anos. [42] [13]

Abastecimento de transformadores pode levar até ~2 anos para muitas utilities (e mais para grandes transformadores de potência segundo alguns relatos), enquanto grandes projetos de transmissão e subestações podem levar vários anos devido a licenças e restrições de equipamentos. Entretanto, lançamentos de modelos na era ChatGPT são frequentemente espaçados por poucos meses, com novas funções “agentivas” (uso de ferramentas, uso de computador, longo contexto) a chegar rápido o suficiente para controles organizacionais ficarem atrás.

Sinais de choque psicológico a curto prazo já são mensuráveis [51]

A ansiedade pública não é hipotética. Uma sondagem Economist/YouGov de 13–16 de fevereiro de 2026 reportou que 63% dos adultos norte-americanos esperam que avanços em IA reduzam o número de empregos, enquanto apenas uma minoria pequena espera aumentos [52]

— uma distribuição invulgarmente desequilibrada para uma narrativa tecnológica. Outra sondagem YouGov no Reino Unido (18 de fevereiro de 2026) encontrou grandes maiorias a esperar impacto moderado ou maior em empregos de colarinho branco/profissionais ao longo de 10 anos. [53] [54]

A incerteza dos trabalhadores está a ser tratada cada vez mais como tema de saúde mental e estabilidade organizacional na psicologia e na pesquisa do trabalho, não apenas como debate tech. A implicação para 2026–2030 é que, mesmo antes de deslocação massiva, stress antecipatório e reação política podem remodelar mercados de trabalho (p. ex., mais sindicalização, backlash, volatilidade de políticas).

Por que a disrupção pode parecer “repentina” mesmo que se construa lentamente [22] [25]

Dados empresariais sugerem que muitas organizações ainda estão no início da integração profunda (experimentação alta, transformação baixa). Isto pode produzir calma enganosa — até que um número relativamente pequeno de “workflows agentes” padronizados amadureça (triagem de suporte ao cliente, revisão/encaminhamento de contratos, reconciliação back-office, manutenção de código), após o que a difusão pode acelerar rapidamente porque empresas copiam playbooks umas das outras.

Dimensões jurídicas, políticas & geopolíticas

Quando isto se torna ilegal ou proibido?

Não existe um único “interruptor” global em que AGI se torna ilegal. Em vez disso, a ilegalidade emerge através de três camadas:

Camada 1: usos proibidos (já ilegais em jurisdições-chave). [5] [55]

Na UE, o AI Act entrou em vigor em 1 de agosto de 2024 e segue aplicação faseada; algumas proibições tornaram-se aplicáveis em 2 de fevereiro de 2025 (p. ex., práticas específicas de “risco inaceitável”). Isto significa que algumas implantações de IA já são ilegais na UE, independentemente do nível do modelo. O “ponto de ilegalidade” é o momento em que um sistema é usado de forma proibida ou de forma regulada sem conformidade.

Camada 2: obrigações de conformidade para modelos de finalidade geral/de ponta (tornando-se executórias segundo um calendário). [5] [56]

As obrigações do AI Act da UE para modelos de IA de finalidade geral começam antes do regime completo “alto risco”, com requisitos adicionais a aplicar-se em agosto de 2026 e agosto de 2027 segundo orientações da Comissão e reportagens relevantes. Para desenvolvedores de ponta, “ilegal” pode significar não cumprir obrigações de transparência/gestão de risco exigidas quando entrarem em vigor (mesmo que o modelo em si não seja proibido).

Camada 3: segurança nacional e controlos transfronteiriços (já em expansão). [57]

Os EUA ainda não têm uma lei federal única e abrangente de IA até meados de 2025 segundo o Congressional Research Service, mas controlos de exportação e restrições tecnológicas internacionais expandiram-se — cobrindo chips avançados e, em alguns enquadramentos, pesos de modelos e transações de compute de alto desempenho. [58]

Neste contexto, “ilegal” pode significar exportar ou transferir tecnologia controlada, pesos de modelos ou capacidade de compute restrita em violação de regras de controlo de exportações — sobretudo na competição EUA–China. [59]

Na China, a regulação não é um AI Act unificado, mas um patchwork em rápida expansão cobrindo sistemas algorítmicos, “deep synthesis”, serviços de IA generativa e (notavelmente) exigências de rotulagem de conteúdo IA/sintético com datas de entrada em vigor (p. ex., medidas de rotulagem de 2025 reportadas como efetivas a 1 de setembro de 2025). Assim, “ilegal” pode significar não cumprir obrigações de rotulagem, registo de segurança ou gestão de conteúdo para serviços públicos de IA generativa. [57]

Resposta prática à sua pergunta: isto torna-se ilegal no momento em que um desenvolvedor ou operador cruza a fronteira legal específica de uma jurisdição — práticas proibidas (UE), exigências de conformidade obrigatórias quando entram em vigor (UE; muitas leis estaduais nos EUA para contextos específicos; regras chinesas de serviço), ou restrições de controlo de exportação/segurança nacional (EUA e outros). As evidências (2024–fevereiro de 2026) não apontam para probabilidade realista de uma proibição geral de “construir IA avançada” adotada pelas grandes potências; o padrão mais provável no curto prazo é endurecimento de restrições em torno de usos, auditoria, segurança, transferência de compute/pesos e responsabilidade, e não uma proibição total da categoria tecnológica.

Por que pausas são irrealistas: a lógica de corrida armamentista já é política explícita

A afirmação de Shumer de uma “corrida armamentista imparável” é fortemente sustentada pela forma como governos descrevem IA: [3]

O “America’s AI Action Plan” da Casa Branca (10 de julho de 2025) afirma explicitamente que os EUA estão numa corrida pela dominância global em IA, enquadra liderança como trazendo benefícios económicos e militares, e insiste na construção de vasta infraestrutura de IA e da energia para a alimentar (“Build, Baby, Build!”). Isto é evidência direta de que o enquadramento executivo norte-americano trata escala em IA e construção energética como imperativo nacional, o que mina estruturalmente a plausibilidade de abrandamentos voluntários.

Uma análise da RAND sobre incentivos EUA–RPC em problemas de segurança nacional ligados a AGI destaca fortes incentivos competitivos para “wonder weapons” e mudanças sistémicas de poder mesmo se a cooperação for desejável em alguns domínios de risco — um terreno clássico de deserção. Quando o ganho percebido é domínio estratégico ou sobrevivência, “coordenação é difícil” não é falha moral; é teoria dos jogos sob incerteza e desconfiança. [60]

Controlos de exportação e contra-controlos reforçam a dinâmica de corrida: o governo dos EUA e relatórios do CRS descrevem expansão de controlos de exportação de semicondutores e restrições tecnológicas para limitar acesso chinês a compute avançado que viabiliza IA, refletindo que “abrandar o outro lado” já é um grande instrumento de governação. A aplicação e as respostas da cadeia de fornecimento do lado chinês (p. ex., restrições em importação de chips, controlos sobre terras raras) também indicam estrutura de escalada mútua. [58] [61]

Geopolítica da energia como a nova geopolítica da IA

Porque a escala já está constrangida por eletricidade em certas regiões, energia torna-se um input estratégico: [4]

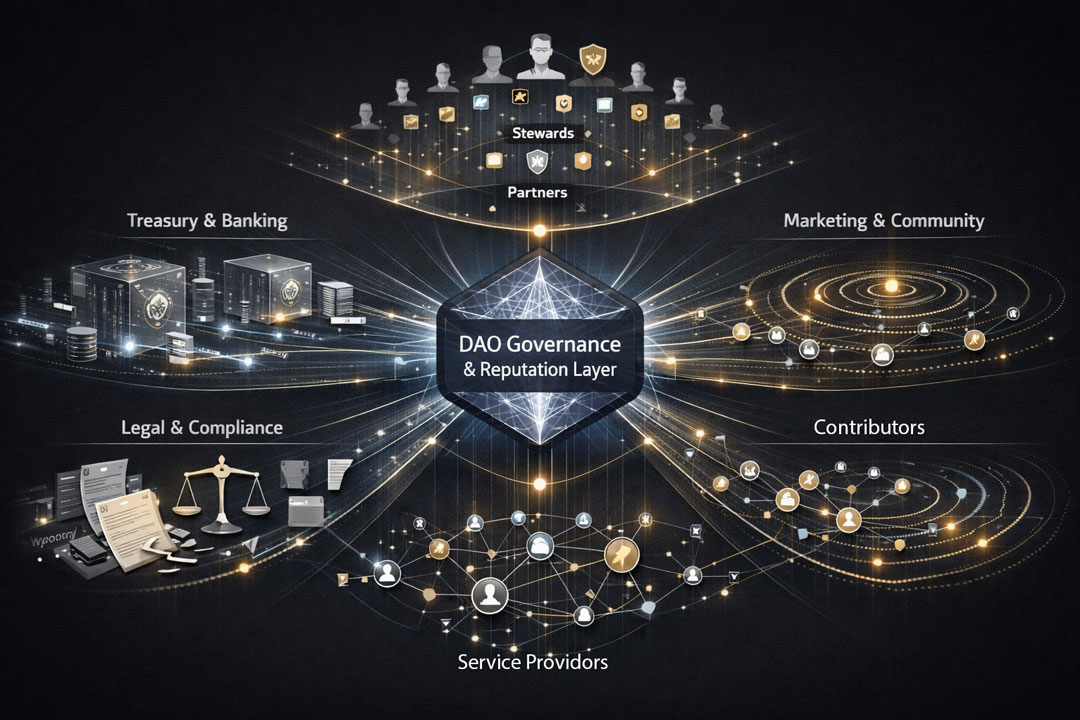

Operadores de rede e reguladores estão a redesenhar regras de acesso para grandes cargas (o “bring-your-own-generation” da PJM; a política irlandesa de ligação de data centers), criando na prática “licenças de acesso à energia”. [3]

Estratégias nacionais estão a fundir IA com prioridades de infraestrutura: documentos de política dos EUA ligam explicitamente dominância em IA a infraestrutura e energia, enquanto utilities e investidores já tratam data centers como motores principais de capex em horizontes de décadas. [36]

Isto significa que, mesmo com avanços algorítmicos, gargalos de energia podem moldar vantagem geopolítica ao determinar que regiões conseguem alojar a próxima onda de treino e inferência de ponta à escala.

Cenários equilibrados, incertezas-chave e aprendizagens acionáveis

Cenários de curto prazo até 2035 com probabilidades baseadas em evidência

Cenário A: vaga de produtividade agentiva sem “AGI completa” (probabilidade ~45%) [2]

Até 2028–2032, sistemas agentivos tornam-se uma camada dominante de produção de colarinhos brancos (código, operações back-office, suporte ao cliente, redação de compliance, workflows de dados) enquanto ainda exigem supervisão humana para decisões de alto risco devido a limites de fiabilidade e alinhamento. Isto é consistente com (a) sinais fortes de capacidade agentiva nos lançamentos de fevereiro de 2026, (b) barreiras de integração empresarial e ROI desigual, e (c) modos conhecidos de colapso de raciocínio em alta complexidade.

Cenário B: “AGI precoce ao nível de laboratório” emerge e difunde-se de forma desigual (probabilidade ~25%) [18]

Entre 2027–2031, um ou mais laboratórios demonstram sistemas que automatizam de forma fiável uma fração muito grande do trabalho intelectual remoto em ambientes controlados (p. ex., limiares do tipo “AI R&D-4” discutidos por labs), desencadeando quedas de contratação mais acentuadas em níveis júnior e reorganização rápida em setores de alta exposição. Isto é suportado por cronogramas agressivos mencionados por alguns líderes de ponta e pela dinâmica de composição interna (modelos a acelerar desenvolvimento de modelos), mas continua limitado por preocupações de segurança e fiabilidade reconhecidas em documentos centrais.

Cenário C: restrições de energia e licenciamento tornam-se o acelerador dominante (probabilidade ~20%) [4]

De 2026 a 2030, o maior gargalo não é a qualidade dos modelos, mas megawatts: atrasos de interligação, compra de transformadores/subestações, restrições de transmissão, conflitos de água/terreno e moratórias regionais forçam relocalização do compute e reduzem a velocidade máxima de escala em hubs críticos. A IA continua a avançar, mas a “velocidade de escala” torna-se dependente de geografia e infraestrutura e mais intensiva em capital — favorecendo incumbentes e projetos apoiados por Estados. Isto alinha-se com mudanças de regras de operadores, alertas da NERC sobre procura, prazos de transformadores e capacidade de data centers parada por falta de energia.

Cenário D: um incidente maior gera endurecimento regulatório parcial sem acabar com a corrida (probabilidade ~10%) [3]

Uma falha muito mediática (p. ex., incidente cibernético severo envolvendo mau uso de modelo, grande vaga de fraude, ou perturbação de infraestrutura crítica ligada a ferramentas de IA) desencadeia endurecimento regulatório rápido: licenças mais estritas para modelos de alta capacidade, reporte obrigatório, regimes de responsabilidade reforçados e/ou expansão de controlos de exportação. No entanto, incentivos de corrida armamentista mantêm o desenvolvimento — a regulação muda onde e como a escala acontece, e não trava a tecnologia. Isto corresponde à combinação de (a) enquadramento explícito de política “ganhar a corrida” e (b) arquiteturas de conformidade existentes (aplicação faseada UE; controlos export) que podem ser ampliadas após choques.

Incertezas-chave que dominam resultados 2026–2035 [12]

A incerteza central é se fiabilidade e alinhamento melhoram tão rápido quanto capacidade. Resultados da Apple sobre “colapso em alta complexidade” e o foco contínuo da OpenAI em reduzir alucinações implicam que “melhor que humano na maioria das tarefas” não é garantido a curto prazo sem mudanças de arquitetura. [42]

A segunda é throughput de infraestrutura: capacidade de fabricar transformadores, velocidade de construção de rede, aceitação política local e restrições de água/arrefecimento podem limitar a escala mesmo com dinheiro abundante. [58]

A terceira é geopolítica: controlos de exportação, restrições de terras raras e iniciativas de “IA soberana” podem redirecionar a escala geograficamente, aumentar custos e reforçar a dinâmica de corrida.

Aprendizagens acionáveis para indivíduos, empresas e decisores [62]

Para indivíduos (2026–2030), o maior leverage é tornar-se “agent-native” no seu domínio — aprender a definir resultados, supervisionar agentes e verificar outputs — porque a maior deslocação de trabalho a curto prazo provavelmente ocorre dentro dos empregos (redesign de tarefas, menos juniores, mais produção por trabalhador) antes do “fim total dos empregos”. [22]

Para empresas, evitar a armadilha de medir valor de IA apenas por adoção de pilotos. Evidência sugere que qualidade de integração e redesign de workflows — não acesso ao modelo em si — determinam ROI. Construir cedo verificação, auditabilidade e controlos de segurança, especialmente para uso agentivo de ferramentas (execução de código, controlo de browser, operações financeiras).

Para decisores, os “mecanismos de estabilidade” mais rápidos não são proibições especulativas de AGI, mas: (1) proteções direcionadas para trabalhadores altamente expostos; (2) regras de responsabilidade e transparência para implantações de alto risco; (3) política industrial para rede/equipamentos (transformadores, subestações, transmissão) evitando que a infraestrutura de IA socialize custos sobre famílias; e (4) controlos export coordenados e padrões de segurança que reduzam incentivos à deserção nos piores casos — reconhecendo que coordenação perfeita é improvável. [24]

Dicas para acompanhar energia/infraestrutura (sinal forte para 2026–2030): monitorizar (a) previsões de carga e mudanças de regras de “grande carga” dos principais operadores (p. ex., PJM), (b) avaliações de fiabilidade (NERC), (c) prazos e indicadores de preço de transformadores (NREL/indústria), (d) moratórias locais para data centers e ordens sobre água, e (e) processos tarifários de utilities que transfiram custos de upgrade de rede para famílias. Estes são indicadores avançados de onde a escala em IA vai acelerar — e onde vai quebrar primeiro.

Ponte de transição: análise de longo prazo deve ancorar-se num pequeno conjunto de factos de curto prazo que já são evidência dura (não especulação): (1) modelos agentivos de ponta entregues em fevereiro de 2026 são explicitamente desenhados para uso de ferramentas em longa duração e estão a ser usados em ciclos de I&D, criando pressão de iteração cumulativa; [7]

(2) líderes importantes falam publicamente de 2026–2027 como janela plausível para capacidade “país de génios”, enquanto céticos ainda apontam horizontes de vários anos a várias décadas, indicando incerteza extrema; (3) o enquadramento de segurança nacional dos EUA (“ganhar a corrida da IA”) torna pausas globais estruturalmente improváveis, intensificando incentivos de deserção EUA–China; (4) a procura elétrica de data centers está prevista para subir fortemente até 2030, e operadores/reguladores já mudam regras por causa de restrição de capacidade; (5) gargalos físicos — transformadores/subestações, transmissão, água, terreno, licenças — tornam-se o fator limitante da escala em IA, e estas mesmas restrições podem aumentar custos de energia das famílias e aprofundar desigualdades.

📊 Explorar visualizações de dados interativas

Ver as 5 visualizações em ecrã inteiro com sliders de ano interativos e vistas alternáveis

Ver gráficos interativos →

Fontes & referências

📊 Explorar visualizações de dados interativas

Ver as 5 visualizações em ecrã inteiro com sliders de ano interativos e vistas alternáveis

Ver gráficos interativos →- Matt Shumer — “Something Big Is Happening”

- OpenAI — System card GPT-5.3-Codex (PDF)

- Casa Branca — America’s AI Action Plan

- Reuters — Acordos de energia da PJM para data centers (fevereiro 2026)

- Comissão Europeia — FAQ do AI Act da UE

- Business Insider — Gary Marcus sobre o ensaio de Shumer

- OpenAI — Apresentação do GPT-5.3-Codex

- Anthropic — Lançamento do Claude Opus 4.6

- Anthropic — Relatório de risco do Claude Opus 4.6

- OpenAI — Apresentação do GPT-5

- OpenAI — Por que modelos de linguagem alucinam

- Apple Research — “The Illusion of Thinking”

- Sam Altman — “The Gentle Singularity”

- Boston Dynamics — Anúncio do novo robô Atlas

- BMW Group — Testes de robôs humanoides

- Reuters — Mercedes-Benz investe na Apptronik

- arXiv — OpenVLA: modelo visão-linguagem-ação open source

- Anthropic — Declaração no Paris AI Summit

- PJM Interconnection — Previsão de crescimento de carga

- Time — Entrevista com Demis Hassabis

- El País — Yann LeCun sobre IA de nível humano

- MLQ — Relatório “State of AI in Business 2025”

- Geoffrey Hinton — Declaração sobre risco de IA

- FMI — A IA vai transformar a economia global

- WEF — Future of Jobs 2025

- OIT — IA generativa e empregos: índice de exposição ocupacional

- Tom’s Hardware — Chefe de IA da Microsoft sobre colarinhos brancos

- Axios — Cronograma de IA de Dario Amodei

- McKinsey — State of AI 2025

- The Guardian — Data centers e uso de água

- Daron Acemoglu (MIT) — “The Simple Macroeconomics of AI”

- OCDE — Ganhos macroeconómicos de produtividade da IA

- FMI — Working Paper: IA e mercados de trabalho (2025)

- Utility Dive — Subida de preços do gás e eletricidade

- Eurostat — Dados sobre preços de energia

- AIE — Relatório “Energy and AI”

- AIE — Electricity 2024

- Reuters — Recordes de consumo elétrico nos EUA

- NERC — Long-Term Reliability Assessment 2024

- CRU Irlanda — Política de ligação de data centers

- KPMG Irlanda — Reset de política de data centers

- NREL — Prazos de transformadores e infraestrutura de rede

- Reuters — Défice de oferta de transformadores nos EUA

- US DOE — Regra final de licenciamento de transmissão

- Tom’s Hardware — Data centers parados à espera de energia

- AP News — Impactos comunitários de data centers

- Business Insider — Data centers no Norte da Virgínia

- Reuters — Southern Co. aumenta plano de despesas

- Reuters — Investimentos em rede nos EUA disparam

- Financial Times — IA e infraestrutura energética

- YouGov/Economist — IA e empregos (fevereiro 2026)

- YouGov UK — Sondagem economia/IA

- American Psychological Association — Incerteza no trabalho

- The Guardian — IA, trabalho e futuro

- Le Monde — Primeiras medidas do AI Act da UE

- Reuters — Regras de IA da UE avançam, sem pausa

- CRS — Data centers e IA (R48555)

- CRS — Rede/energia e IA (R48642)

- Technology’s Legal Edge — Rotulagem de conteúdo IA na China

- RAND — Corrida de IA EUA–China como dilema do prisioneiro

- Financial Times — Investimento em infraestrutura de IA

- Business Insider — CEO da Anthropic sobre empregos de engenharia